L'evoluzione dell'NLP: Dall'IA frammentata ai modelli fondamentali

Definizioni

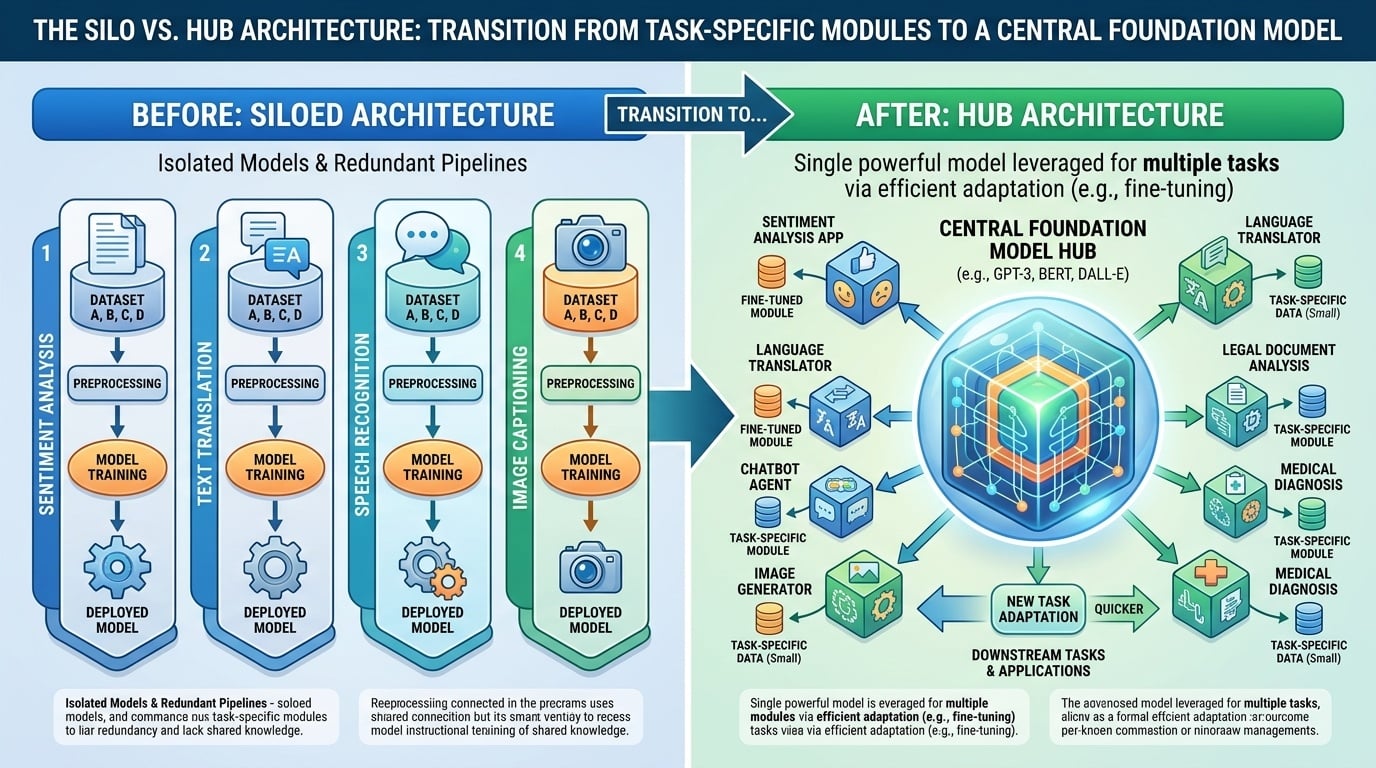

- Intelligenza Artificiale Frammentata: Un'era caratterizzata da architetture neurali discrete e specializzate progettate per compiti specifici come l'etichettatura di sequenze o la classificazione.

- Modello Fondamentale: Un'architettura trasformista unificata e monolitica che tratta tutti i problemi linguistici come una sequenza testuale generativa $x \rightarrow y$.

Concetti Fondamentali

- Consolidamento Architetturale: Storicamente, l'NLP richiedeva pipeline personalizzate (Bi-LSTM per il riconoscimento delle entità nominate, CNN per l'analisi del sentiment). I modelli linguistici generali riducono questi silos in un'unica struttura portante dove gli stessi pesi vengono utilizzati per ogni compito.

- L'Interfaccia Unificata: I modelli linguistici generali sostituiscono le "testine di output" specializzate (ad esempio, Softmax a 3 classi) con un'interfaccia basata sul linguaggio naturale. Input e output sono sempre stringhe, consentendo al modello di interpretare intento piuttosto che formato.

- Trasferimento della Conoscenza: I modelli tradizionali erano "una lavagna bianca" per ogni compito. I modelli linguistici generali privilegiano Generalizzazione Prima, dove compiti specifici sono semplici applicazioni di una rappresentazione interna robusta e preesistente del linguaggio.

Contesto Storico

- Prima del 2018: L'isolamento dei compiti richiedeva l'addestramento di modelli distinti con funzioni di perdita diverse $\mathcal{L}_{task}$.

- Era Moderna: Il paradigma "Testo-a-Testo" permette a un singolo modello (ad esempio, Llama-3) di cambiare compiti tramite prompt a zero-shot o few-shot.

Confronto Implementazione in Python